Google Chrome: Безопасность ИИ-ассистентов

Браузеры всё чаще экспериментируют с функциями ИИ-ассистентов, способных выполнять задачи от имени пользователя, например, бронировать билеты или совершать покупки. Однако такие возможности несут в себе риски безопасности, которые могут привести к потере данных или финансовых средств.

Google представила свой подход к обеспечению безопасности пользователей в Chrome, используя модели наблюдения и механизм согласия на выполнение действий. Компания анонсировала первые ИИ-функции в Chrome в сентябре, и их внедрение ожидается в ближайшие месяцы.

Для контроля действий ИИ-ассистентов Google задействует несколько моделей. В частности, разработана модель User Alignment Critic на базе Gemini, которая анализирует задачи, предложенные планирующей моделью. Если критикующая модель считает, что предложенные задачи не соответствуют цели пользователя, она запрашивает пересмотр стратегии у планировщика. Важно отметить, что критикующая модель обрабатывает только метаданные предлагаемых действий, а не их полное содержание.

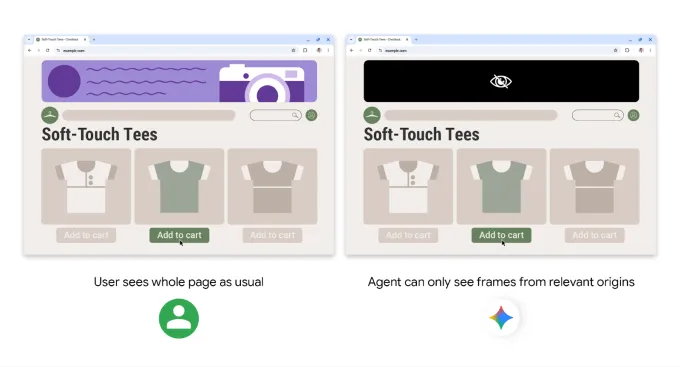

Чтобы предотвратить доступ ассистентов к недопустимым или ненадежным сайтам, Google использует Agent Origin Sets. Эта система ограничивает доступ модели к источникам, которые можно только читать, и к источникам с возможностью чтения и записи. Источники только для чтения содержат информацию, которую Gemini может потреблять. Например, на сайте покупок это могут быть списки товаров, но не рекламные баннеры. Google также разрешает ассистенту взаимодействовать только с определенными элементами iframe на странице.

Такое разделение гарантирует, что ассистент имеет доступ только к данным из ограниченного набора источников, и эти данные могут передаваться только в разрешенные для записи источники. Это существенно снижает риск утечки данных между различными источниками. Браузер также может обеспечить такое разделение, не передавая модели данные, выходящие за рамки разрешенного для чтения набора.

Google также контролирует навигацию по страницам с помощью дополнительной модели наблюдения, анализирующей URL-адреса. Это помогает предотвратить переход на вредоносные ссылки, сгенерированные моделью.

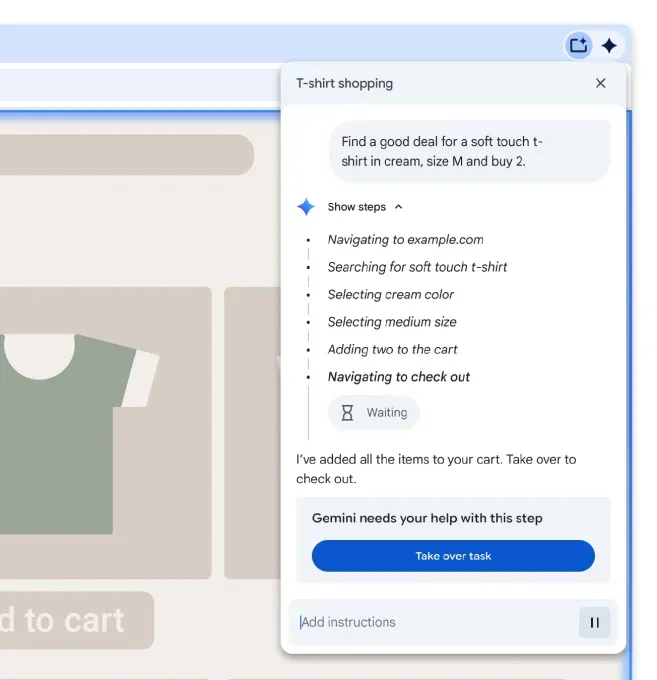

Поисковый гигант также предоставляет пользователям контроль над конфиденциальными задачами. Например, при попытке ассистента перейти на чувствительный сайт (банковский, медицинский) система сначала запрашивает разрешение у пользователя. Для сайтов, требующих входа в систему, Chrome запросит разрешение на использование менеджера паролей. Отмечается, что модель ассистента не имеет доступа к паролям. Компания также будет запрашивать у пользователей подтверждение перед выполнением таких действий, как совершение покупки или отправка сообщения.

В дополнение к этому, Google применяет классификатор для предотвращения инъекций команд (prompt injection), чтобы избежать нежелательных действий. Компания также проводит тестирование возможностей ИИ-ассистентов на предмет уязвимостей, выявляемых исследователями.

Разработчики браузеров с ИИ-функциями также уделяют внимание безопасности. Например, Perplexity недавно представила новую модель обнаружения контента с открытым исходным кодом для защиты от атак типа prompt injection.

Галерея

Комментарии

Комментариев пока нет.